Lavender Milik Zionis Israel, Mesin AI Pemandu Pembantai Warga Gaza

Mengenal Lavender Milik Israel, Mesin AI Pemandu Pembataian Warga Gaza-Screenshoot/YouTube-

JAKARTA, DISWAY.ID - Militer Israel telah menggunakan alat kecerdasan buatan (AI) yang dikenal sebagai 'Lavender', untuk mengidentifikasi sasaran di Gaza dan mengarahkan serangan pengeboman mereka, yang menyebabkan 33.000 warga Palestina terbunuh sejak Oktober.

Lavender telah memainkan peran penting dalam pemboman, yang belum pernah terjadi sebelumnya terhadap warga Palestina, demikian penyelidikan yang dilakukan oleh +972 Magazine dan Local Call, menyatakan dan berdasarkan pada petugas intelijen yang memiliki pengalaman langsung menggunakan alat AI dalam perang di Jalur Gaza.

Sumber mengatakan bahwa 15 atau 20 warga sipil bisa terbunuh jika menargetkan anggota tingkat rendah Hamas.

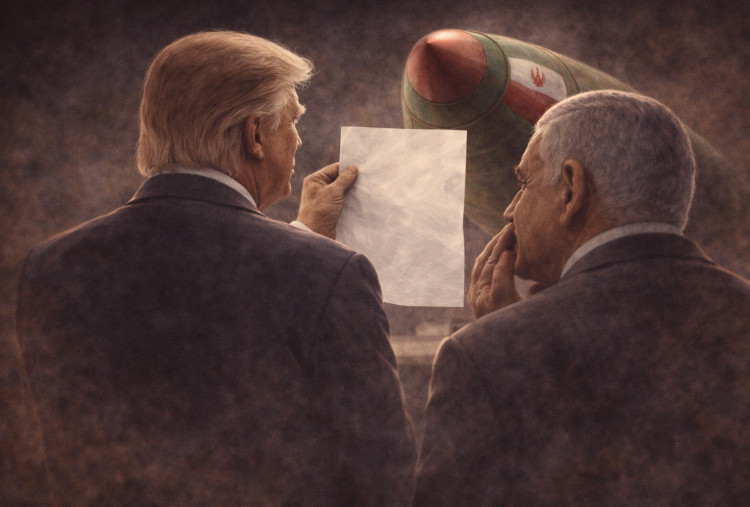

BACA JUGA:Israel dan Iran Diambang Perang, Garda Revolusi Siap Lancarkan Serangan Balasan

Sementara militer mengizinkan pembunuhan sebanyak 100 warga sipil untuk membunuh seorang komandan Hamas, seperti yang terjadi dengan perataan blok apartemen pada tanggal 31 Oktober .

Sumber tersebut mengatakan bahwa alat tersebut memiliki pengaruh yang signifikan terhadap operasi militer, sampai-sampai mereka memperlakukan keluaran mesin AI “seolah-olah itu adalah keputusan manusia”.

Meskipun sistem Lavender dirancang untuk menandai tersangka anggota Hamas dan Jihad Islam Palestina (PIJ), dalam beberapa minggu pertama perang, mesin tersebut mengidentifikasi sekitar 37.000 warga Palestina, dan rumah mereka, sebagai “tersangka”, yang dapat dijadikan sasaran. serangan udara bahkan jika anggota keluarga ada di rumah.

BACA JUGA:Partai Gantz Siap Gulingkan Benjamin Netanyahu Sebagai Perdana Menteri Israel

BACA JUGA:Israel Bantah Bunuh WCK, Pekerja Bantuan Sengaja Dijadikan Sasaran Pembantaian di Gaza

Diserang s]Secara sistematis

Alat AI diketahui memiliki tingkat kesalahan 10 persen tetapi pada tahap awal perang tidak ada persyaratan bagi tentara untuk menyelidiki dengan tepat bagaimana mesin tersebut memilih targetnya.

“ Tentara Israel secara sistematis menyerang orang-orang yang menjadi sasaran ketika mereka berada di rumah biasanya pada malam hari ketika seluruh keluarga mereka hadir dan bukan selama aktivitas militer,” demikian isi penyelidikan.

Salah satu perwira intelijen yang bertugas dalam perang tersebut mengatakan kepada +972 bahwa "lebih mudah" untuk mengebom sebuah rumah keluarga daripada membunuh tersangka militan ketika mereka jauh dari warga sipil lainnya.

Cek Berita dan Artikel lainnya di Google News

Temukan Berita Terkini kami di WhatsApp Channel

Sumber: